专做ppt的网站seo排名快速上升

文章目录

- 一、爬取目标

- 二、展示爬取结果

- 三、爬虫代码

- 四、同步视频

- 五、附完整源码

您好,我是 @马哥python说,一枚10年程序猿。

一、爬取目标

之前,我分享过一些B站的爬虫:

【Python爬虫案例】用Python爬取李子柒B站视频数据

【Python爬虫案例】用python爬哔哩哔哩搜索结果

【爬虫+情感判定+Top10高频词+词云图】"谷爱凌"热门弹幕python舆情分析

但我学习群中小伙伴频繁讨论B站评论的爬取,所以,再分享一个B站视频评论的爬虫。

二、展示爬取结果

首先,看下部分爬取数据:

爬取字段含:视频链接、评论页码、评论作者、评论时间、IP属地、点赞数、评论内容。

三、爬虫代码

导入需要用到的库:

import requests # 发送请求

import pandas as pd # 保存csv文件

import os # 判断文件是否存在

import time

from time import sleep # 设置等待,防止反爬

import random # 生成随机数

定义一个请求头:

# 请求头

headers = {'authority': 'api.bilibili.com','accept': 'application/json, text/plain, */*','accept-language': 'zh-CN,zh;q=0.9,en;q=0.8,en-GB;q=0.7,en-US;q=0.6',# 需定期更换cookie,否则location爬不到'cookie': "需换成自己的cookie值",'origin': 'https://www.bilibili.com','referer': 'https://www.bilibili.com/video/BV1FG4y1Z7po/?spm_id_from=333.337.search-card.all.click&vd_source=69a50ad969074af9e79ad13b34b1a548','sec-ch-ua': '"Chromium";v="106", "Microsoft Edge";v="106", "Not;A=Brand";v="99"','sec-ch-ua-mobile': '?0','sec-ch-ua-platform': '"Windows"','sec-fetch-dest': 'empty','sec-fetch-mode': 'cors','sec-fetch-site': 'same-site','user-agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/106.0.0.0 Safari/537.36 Edg/106.0.1370.47'

}

请求头中的cookie是个很关键的参数,如果不设置cookie,会导致数据残缺或无法爬到数据。

那么cookie如何获取呢?打开开发者模式,见下图:

由于评论时间是个十位数:

所以开发一个函数用于转换时间格式:

def trans_date(v_timestamp):"""10位时间戳转换为时间字符串"""timeArray = time.localtime(v_timestamp)otherStyleTime = time.strftime("%Y-%m-%d %H:%M:%S", timeArray)return otherStyleTime

向B站发送请求:

response = requests.get(url, headers=headers, ) # 发送请求

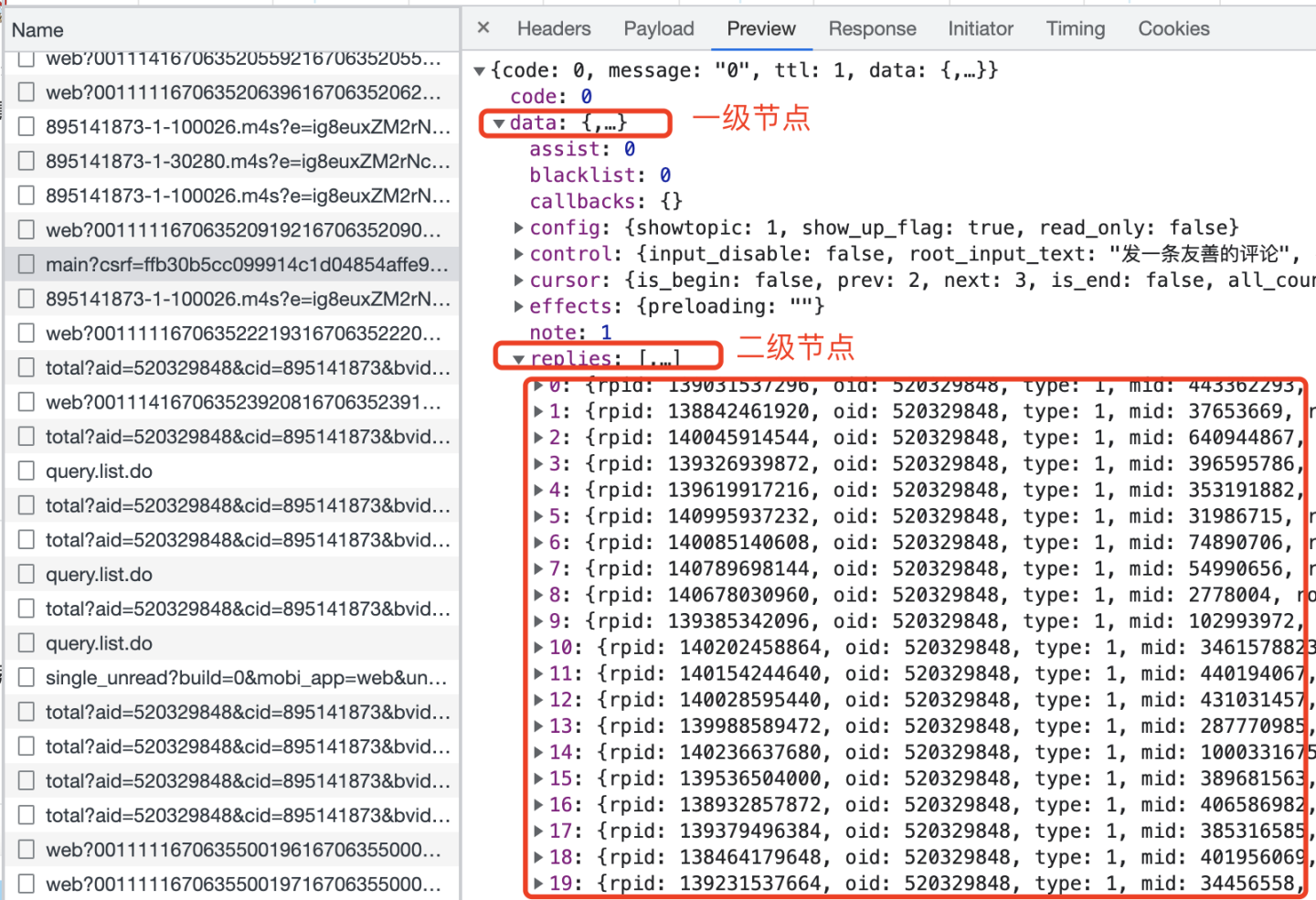

接收到返回数据了,怎么解析数据呢?看一下json数据结构:

0-19个评论,都存放在replies下面,replies又在data下面,所以,这样解析数据:

data_list = response.json()['data']['replies'] # 解析评论数据

这样,data_list里面就是存储的每条评论数据了。

接下来吗,就是解析出每条评论里的各个字段了。

我们以评论内容这个字段为例:

comment_list = [] # 评论内容空列表

# 循环爬取每一条评论数据

for a in data_list:# 评论内容comment = a['content']['message']comment_list.append(comment)

其他字段同理,不再赘述。

最后,把这些列表数据保存到DataFrame里面,再to_csv保存到csv文件,持久化存储完成:

# 把列表拼装为DataFrame数据

df = pd.DataFrame({'视频链接': 'https://www.bilibili.com/video/' + v_bid,'评论页码': (i + 1),'评论作者': user_list,'评论时间': time_list,'IP属地': location_list,'点赞数': like_list,'评论内容': comment_list,

})

# 把评论数据保存到csv文件

df.to_csv(outfile, mode='a+', encoding='utf_8_sig', index=False, header=header)

注意,加上encoding=‘utf_8_sig’,否则可能会产生乱码问题!

下面,是主函数循环爬取部分代码:(支持多个视频的循环爬取)

# 随便找了几个"世界杯"相关的视频ID

bid_list = ['BV1DP411g7jx', 'BV1M24y117K3', 'BV1nt4y1N7Kj']

# 评论最大爬取页(每页20条评论)

max_page = 30

# 循环爬取这几个视频的评论

for bid in bid_list:# 输出文件名outfile = 'b站评论_{}.csv'.format(now)# 转换aidaid = bv2av(bid=bid)# 爬取评论get_comment(v_aid=aid, v_bid=bid)

四、同步视频

演示视频:

【2023爬虫演示】用python抓取上千条「卡塔尔世界杯」B站评论!

五、附完整源码

附完整代码: 【B站评论爬虫】用python爬取上千条哔哩哔哩评论

我是马哥,全网累计粉丝上万,欢迎一起交流python技术。

各平台搜索“马哥python说”:知乎、哔哩哔哩、小红书、新浪微博。